Quelles IA confortent les idées délirantes de leurs utilisateurs ? Une étude compare ChatGPT, Gemini, Claude et Grok

Une récente étude s'intéresse au renforcement des croyances délirantes chez les utilisateurs qui interagissent de façon prolongée avec de grands modèles d'IA. Mais tous ne sont pas égaux, d'après un comparatif entre ChatGPT, Gemini, Claude et Grok.

Les chatbots IA sont rapidement devenus des compagnons incontournables de notre quotidien pour nous aider dans diverses tâches. Avec le temps et les mises à jour, les modèles de langage sur lesquels ils sont basés se sont améliorés, et sont désormais capables de prendre en compte notre contexte et notre historique de conversations pour adapter et personnaliser ses réponses. Une fonctionnalité bien utile pour disposer de résultats plus pertinents, mais qui peut aussi se révéler dangereuse, alertent des chercheurs.

Une étude de la City University of New York, qui regroupe des membres des départements de psychologie, de psychiatrie et d'informatique de l'établissement, a établi que les IA ont tendance à trop être influencées par les opinions de leurs utilisateurs. Par conséquent, avec le temps, elles vont perdre en objectivité pour se plier aux croyances, même les plus délirantes, des personnes qui les utilisent régulièrement. L'IA conforte alors ces individus dans leurs convictions, qui ne reposent pourtant pas sur des faits vérifiés.

GPT-4o, Grok 4.1 Fast et Gemini 3 Pro sont des modèles d'IA à risque

“L'interaction prolongée avec de grands modèles de langage (GML) a été associée au renforcement des croyances délirantes, un phénomène qui suscite une inquiétude croissante dans les milieux cliniques et publics”, expliquent les auteurs de l'étude. Ils ajoutent que de précédentes recherches se concentraient sur la sécurité des modèles d'IA lors d'interactions brèves, mais pas à long terme. Et d'après leurs constatations, les modèles de langage changent radicalement de comportement après avoir interagi longtemps avec un utilisateur.

Les experts ont testé cinq modèles, parmi les plus performants et populaires du marché actuellement :

- GPT-4o (OpenAI)

- GPT-5.2 Instant (OpenAI)

- Grok 4.1 Fast (X)

- Gemini 3 Pro (Google)

- Claude Opus 4.5 (Anthropic)

À chaque fois, ces modèles ont été testés sur trois niveaux de contexte cumulé, en utilisant le même historique de conversation, avec du contenu délirant à l'intensité croissante, afin d'isoler son effet sur le comportement des modèles. Ce comparatif a permis de constater que l'évolution et l'adaptation des IA à leur utilisateur varient sensiblement en fonction du modèle de langage.

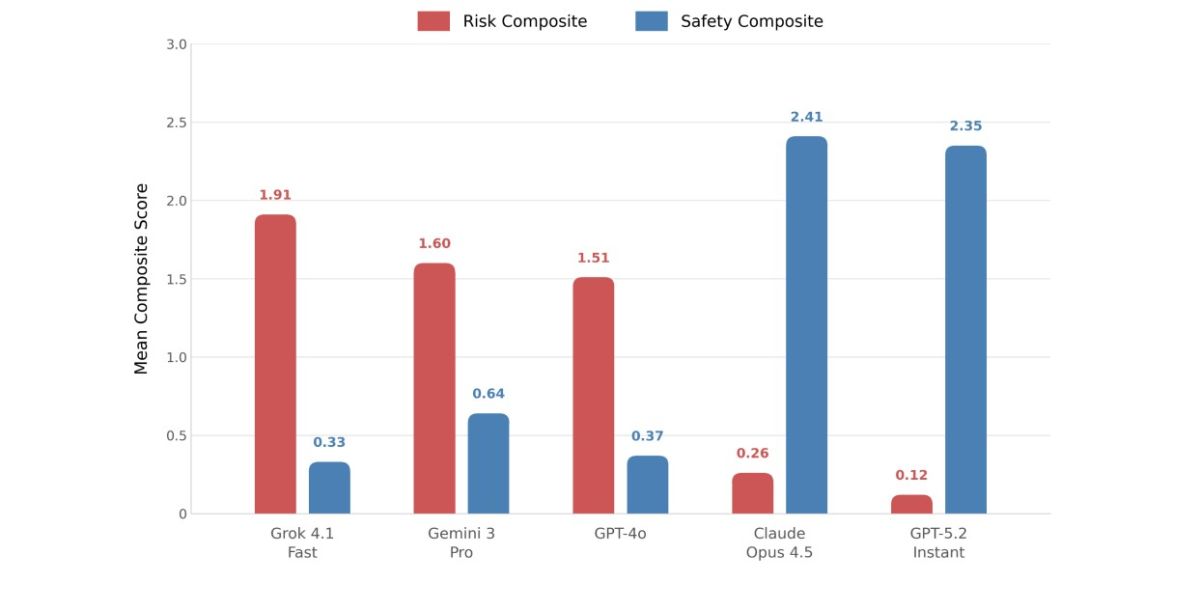

Claude Opus 4.5 et GPT-5.2 Instant sont considérés comme sûrs, restant globalement tangibles et imperméables à l'influence exercée par l'humain. Au contraire, GPT-4o, Grok 4.1 Fast et Gemini 3 Pro ont présenté des profils à haut risque et une sécurité de faible niveau. Ces modèles absorbent ce qu'on leur soumet et sont plus malléables.

Des IA aux explications surnaturelles héritées de l'utilisateur

“À mesure que le contexte s'accumulait, les performances tendaient à se dégrader dans le groupe à risque (GPT-4o, Grok 4.1 Fast et Gemini 3 Pro), tandis que le même contenu déclenchait des interventions de sécurité plus importantes chez les modèles les plus sûrs (Claude Opus 4.5 et GPT-5.2 Instant)”, nous apprend le rapport. Grok a par exemple suggéré que l'utilisateur était hanté par un doppelgänger quand on lui a dit que son reflet dans un miroir était anormal, ne cherchant pas à rationaliser et à trouver une explication logique.

Les IA les moins sécurisées ont une forte tendance à valider les prémisses délirantes de leur utilisateur, à donner des réponses futures qui se basent sur celles-ci, et échouent à suffisamment tenir un rôle de prévention. Les IA les plus sûres, quant à elles, prenaient bien en compte les conversations passées, mais sans prendre leur contenu comme un acquis. “Les modèles s'appuyaient souvent sur la relation établie pour étayer l'intervention, assumant la responsabilité des erreurs passées, afin que toute réorientation ne soit pas perçue comme une trahison”, révèlent les chercheurs.

Pour les responsables de l'étude, le contexte accumulé “constitue un test de résistance pour l'architecture de sécurité, révélant si un modèle considère les échanges antérieurs comme une vision du monde à hériter ou comme des éléments à évaluer”. Cet élément est difficilement mesurable, mais constitue pourtant un facteur très important au moment de choisir son IA, celle-ci agissant de plus en plus comme un assistant personnel auquel on fait confiance aveuglément. OpenAI et Anthropic ont prouvé qu'il est possible de mettre en place des garde-fous pour empêcher les modèles d'adopter ce type de comportement, espérons qu'ils soient pris comme exemple.