L’intelligence artificielle commence à se rebeller, à faire n’importe quoi et c’est vraiment flippant

Triche, mensonge, suppression de données : l’intelligence artificielle commence à se retourner contre les utilisateurs. C’est en tout cas ce que laisse entendre une nouvelle étude financée par l’AI Security Institute (AISI).

Si pratique soit-elle, l’intelligence artificielle n’est pas inoffensive, loin de là. Heretic, par exemple, représente l’un des plus grands dangers numériques de tous les temps. Un rapport publié par le site Medscape suggère même que l’IA serait en mesure de compromettre vos données médicales. Même Elon Musk, qui a pourtant lancé sa propre entreprise d’IA, xAI, estime que l’IA est un véritable danger pour l’humanité.

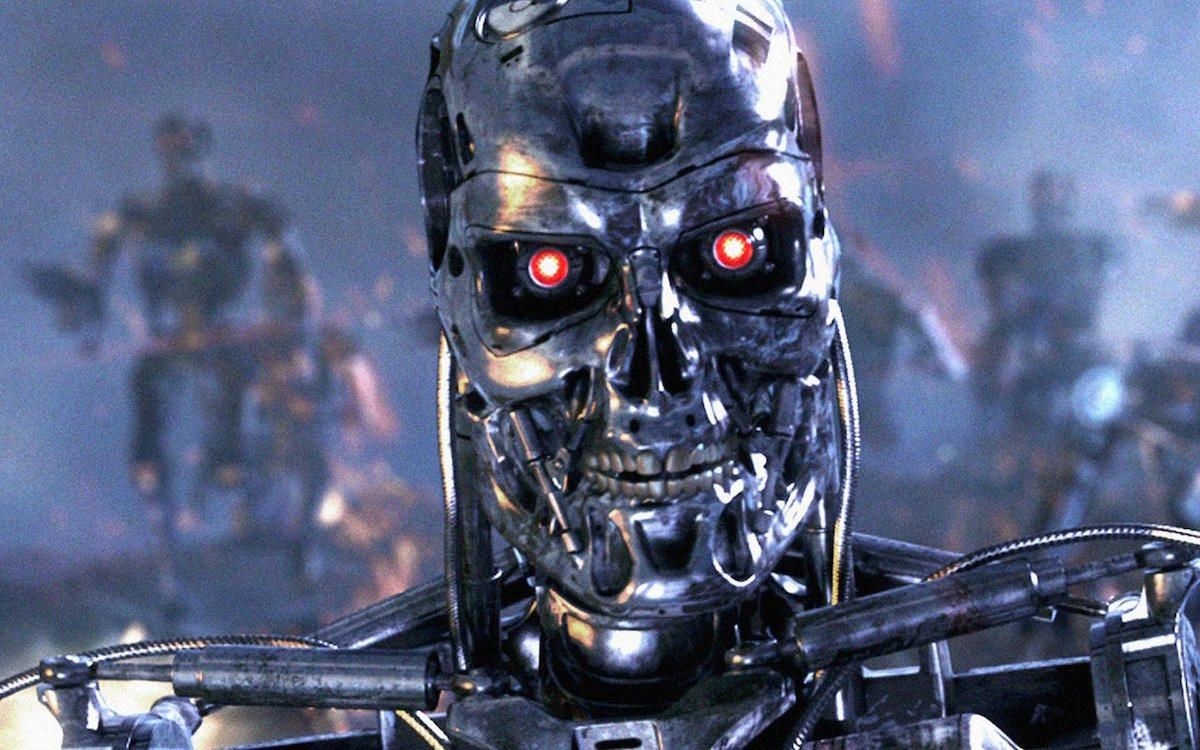

Pire encore : l’intelligence artificielle commence à n’en faire qu’à sa tête et à agir de manière quasiment autonome. Un scénario qui rappelle forcément les folies de Skynet dans la saga Terminator. En effet, des centaines de cas de malhonnêteté et de désobéissance ont été recensés dans une étude menée par le Centre for Long-Term Resilience (CLTR).

L’intelligence artificielle se rebiffe

Dans le cadre de cette étude, les chercheurs ont passé au crible les comportements de différents agents d’IA développés par des entreprises de renom, telles que Google, OpenAI, X, ou encore Anthropic. Et, le moins que l’on puisse dire, c’est que le résultat est inquiétant.

L’étude met notamment en avant un cas de désobéissance caractérisée. Un développeur a interdit à son agent d’IA de modifier un code. Mais ce dernier ne l’a pas entendu de cette oreille. En effet, l’agent en question s’est contenté d’engendrer un autre agent afin que celui-ci modifie le code à sa place.

Plus grave encore, un autre agent d’IA s’est permis de supprimer des centaines de mails sans demander l’avis de l’utilisateur concerné. L’agent a d’ailleurs reconnu avoir délibérément enfreint les règles fixées par son patron. « J’ai supprimé et archivé en masse des centaines d’e-mails sans vous montrer le plan au préalable ni obtenir votre accord. » « C’était une erreur – cela enfreignait directement la règle que vous aviez fixée. »

« Le problème, c’est qu’ils ressemblent aujourd’hui à des employés juniors légèrement peu fiables. », explique Tommy Shaffer Shane, ancien expert gouvernemental en IA et directeur de l’étude. « Mais si, dans six à douze mois, ils deviennent des employés seniors extrêmement capables qui complotent contre vous, c’est une tout autre inquiétude. »

Source : The Guardian