La nouvelle IA de Google qui aide à chercher sur le web rend-t-elle bête ?

Google AI Overviews, la dernière incursion de l'IA dans les recherches, est-elle vraiment bénéfique aux utilisateurs ? Une étude de chercheurs montre que cette nouveauté ne pousse pas vraiment les internautes à réfléchir. Ou à visiter un résultat pour trouver eux-mêmes la réponse.

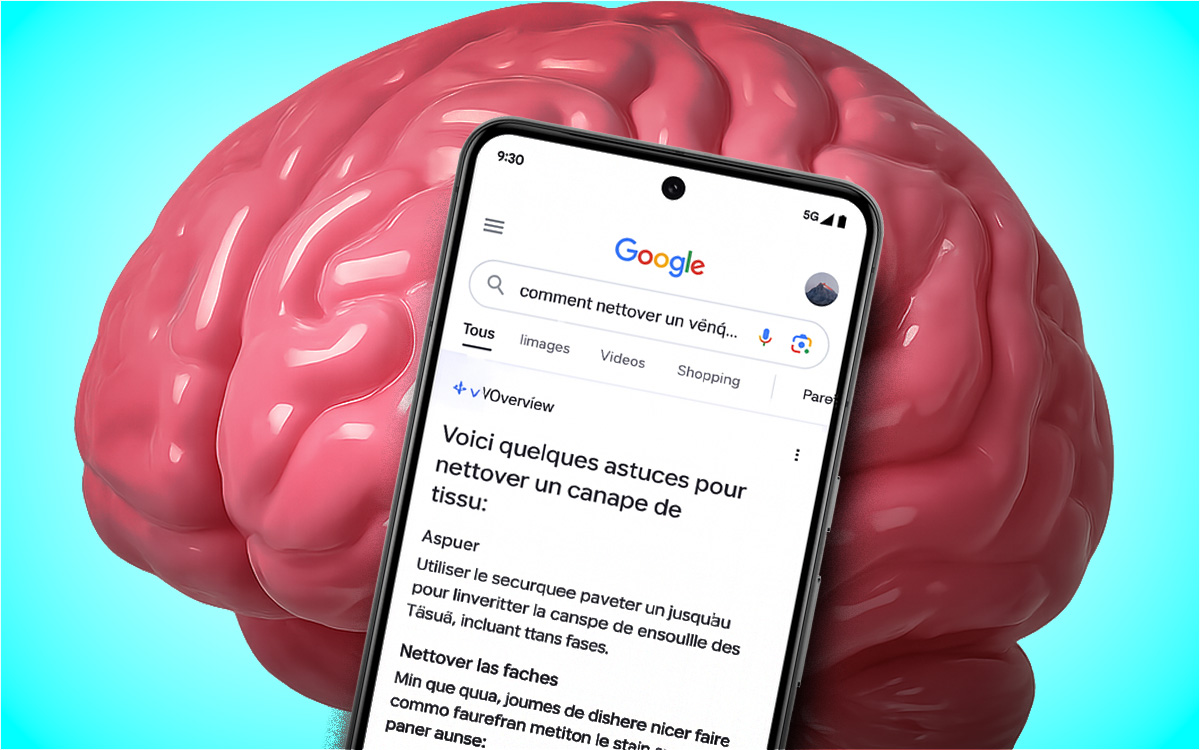

Alors que Google continue le déploiement de AI Overviews, une étude pousse à réfléchir sur l'impact de ce type d'assistance. AI Overviews est une nouveauté qui affiche une réponse rapide en haut des résultats de Google lors de certaines recherches. La fonctionnalité s'appuie sur l'IA générative Gemini de la firme. Et elle peut effectivement offrir une réponse rapide à des demandes simples.

Mais il faut tout de même relever que l'exactitude de ce qui s'affiche n'est pas toujours au rendez-vous. Et que parcourir les résultats soi-même reste, dans de nombreux cas, fortement conseillé. Mais est-ce vraiment ce que font les utilisateurs ? À en croire une nouvelle étude de Pew Research Center basée sur 900 réponses d'internautes américains, pas vraiment.

Les réponses de l'IA lors de certaines recherches dans Google sont-elles vraiment bénéfiques ?

Lorsque AI Overviews s'affiche, il apparaît que les utilisateurs cliquent moins sur les résultats qui leur permettrait pourtant de faire leur propre fact-checking. Et on parle d'une baisse réellement drastique du nombre de clics : seuls 1% des répondants affirment cliquer sur un résultat après l'affichage de AI Overviews.

Un comportement qui en rappelle bien d'autres liés à la généralisation de nouvelles technologies. On pense par exemple aux applications GPS qui ont tendance à nous rendre dépendant d'elles pour se déplacer et réduisent notre capacité à se repérer sans aide. La conclusion de l'étude rejoint d'ailleurs les propos de Sam Altman, le patron de OpenAI qui s'inquiète de la dépendance grandissante des jeunes à l'IA.

Malgré le risque important d'erreurs, ces utilisateurs auraient tendance à faire un peu trop confiance aux réponses de services comme ChatGPT. Des modèles de langage large qu'ils intègrent par ailleurs à leurs activités quotidiennes, suscitant des échanges fréquents – avec les risques potentiels que cela implique. De quoi se demander si, au fond, le plus grand danger l'IA n'était pas déjà en train de se manifester : et si on se dirigeait vers une lente atrophie de l'intelligence humaine ?