Google Lens : la recherche multiple sera bientôt disponible en France

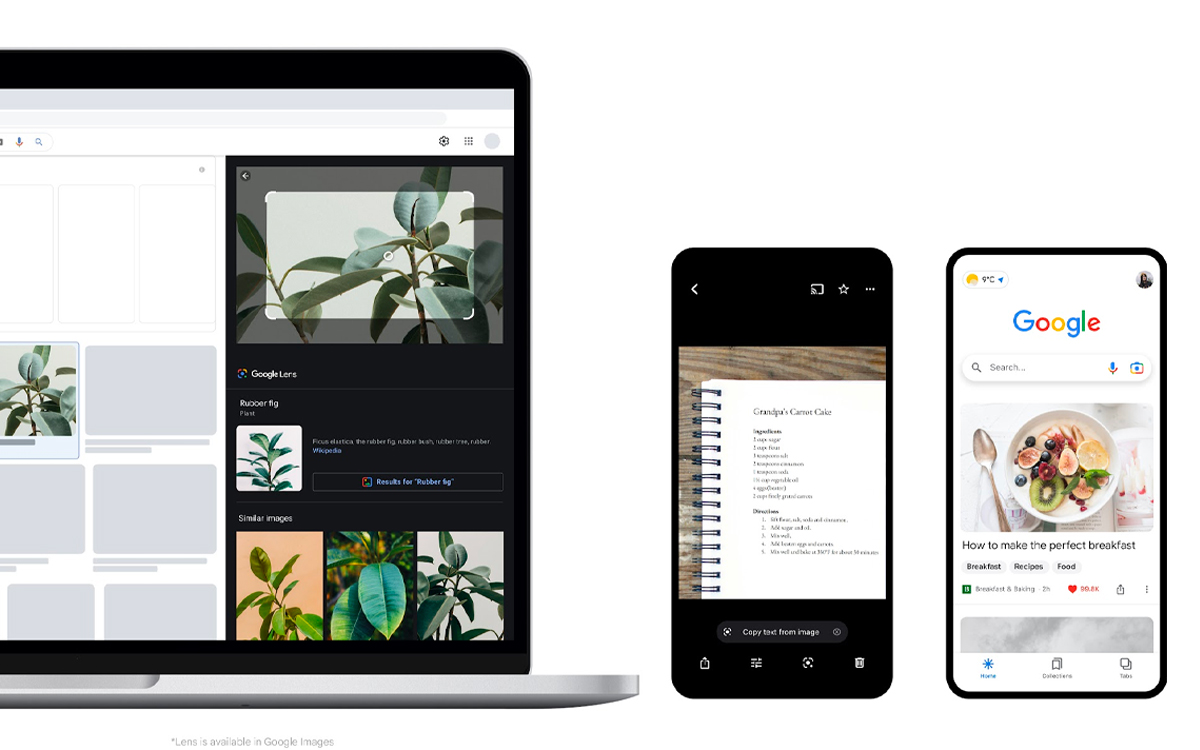

Google Lens va bientôt franchir une étape. En effet, la fonctionnalité de recherche multiplie également appelé Multisearch sera bientôt disponible en France. Jusqu'à présent, cet outil était accessible uniquement aux Etats-Unis et prenait en charge l'anglais seulement.

Au cas où vous le sauriez pas, ce 28 septembre 2022 a été marqué par la tenue de l'édition 2022 de la Google Search On. Il s'agit de la conférence du constructeur dédiée à ses technologies de recherche textuelle visuelle, comme Google Lens par exemple.

Et justement, la firme de Mountain View a annoncé du nouveau concernant son moteur de recherche visuel. En effet, la recherche multiplie présentée en avril 2022 lors de la conférence Google I/O sera bientôt disponible en 70 langues dont le Français.

Pour faire simple, la recherche multiplie offre une toute nouvelle façon d'effectuer des recherches en utilisant à la fois des images et du texte, sans oublier la voix. Par exemple, si vous prenez une plante en photo via Google Lens, vous pourrez ajouter aux résultats de recherche des conseils pour l'entretenir par exemple. Il suffit de taper votre demande dans Lens. La combinaison de l'image, de la voix et du texte dans une seule requête permettra d'affiner les résultats obtenus.

A lire également : Google Lens débarque enfin sur Google Chrome pour faciliter les recherches

Google Lens veut faciliter les recherches près de chez vous

Par ailleurs, Google a annoncé l'entrée en phase de test de la fonction “Multisearch near to Me”, ou dans la langue de Molière, la recherche multiple près de chez moi. Le principe est le même, sauf que vous pourrez demander à Google Lens de fournir des résultats proches de votre localisation géographique. Un exemple : si vous soumettez la photo d'un plat à Google Lens, le moteur de recherche visuel sera en mesure de vous dire si un restaurant proche de chez vous le sert.

L'idée est encore de faciliter les recherches et d'offrir des résultats toujours plus pertinents. Néanmoins, le “Multisearch near to me” est pour l'instant disponible qu'aux Etats-Unis et ne prend en charge que l'anglais. Il faudra attendre un peu avant d'en profiter en France.

On note enfin des progrès sur la traduction via Google Lens. En effet, cette fonction passe un cap. Grâce une technologie d'apprentissage automatique baptisée “Generative Adversarial Network” ou des réseaux antagonistes génératifs, Google est en mesure d'intégrer le texte traduit dans l'image d'arrière-plan.

En d'autres termes, la traduction ne sera plus affichée en flottant au-dessus du texte original, elle le remplacera directement sur la photo. Avec cette fonctionnalité, Google veut rendre la traduction par Google Lens plus naturelle et réaliste.